Artigo

Como detectar e corrigir alucinações antes de publicar

No mundo da produção de conteúdo para PMEs, é comum recorrer a ferramentas de IA para acelerar tarefas como rascunho, revisão e geração de ideias. No entanto, um desafio frequente são as alucinações — afirmações incorretas, números inadequados ou citações inexistentes que parecem confiáveis à primeira leitura. Isso pode prejudicar a credibilidade da marca, levar…

No mundo da produção de conteúdo para PMEs, é comum recorrer a ferramentas de IA para acelerar tarefas como rascunho, revisão e geração de ideias. No entanto, um desafio frequente são as alucinações — afirmações incorretas, números inadequados ou citações inexistentes que parecem confiáveis à primeira leitura. Isso pode prejudicar a credibilidade da marca, levar a erros legais ou a perda de confiança do leitor. O objetivo deste texto é mostrar como detectar rapidamente essas alucinações e corrigi-las antes de publicar, usando um fluxo simples que qualquer equipe pode incorporar no dia a dia. Você vai entender como identificar sinais de erro, validar informações com fontes seguras e manter um processo de revisão que realmente funciona.

A ideia central é que ninguém precisa se virar sozinho diante desse desafio. Ao terminar este guia, você terá um conjunto de diretrizes claras, um checklist acionável e um roteiro de revisão que reduz o retrabalho, aumenta a qualidade do conteúdo e protege a reputação da empresa. O foco é prática, não promessas de ranking: tratar cada afirmação como provável apenas até que seja comprovada de forma rápida e transparente. Se você trabalha com blogs, landing pages ou materiais institucionais, este conteúdo pode se tornar uma referência salva no seu fluxo de trabalho.

Entendendo as alucinações em conteúdo gerado por IA

Definição prática: o que são alucinações no contexto de IA

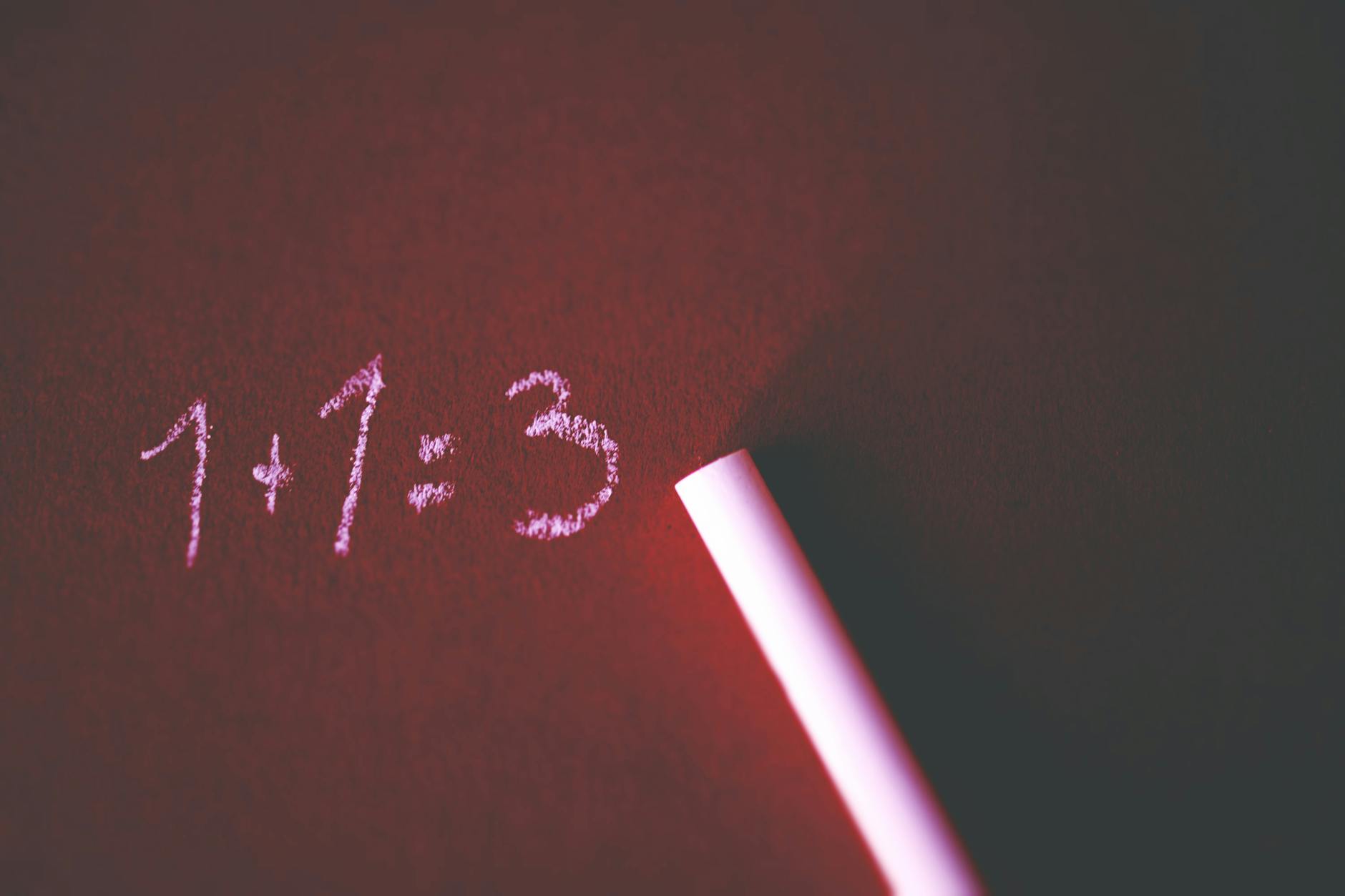

Em termos simples, alucinações são informações produzidas pela IA que não correspondem a dados reais, fontes verificáveis ou contexto plausível. Não se trata de criatividade intencional, mas de uma falha de validação interna do modelo: ele gera um trecho que parece coerente, mas não tem base factual. Para equipes de marketing, isso pode significar afirmações sobre datas de fundação, números de venda, citações de executivos ou descrições de produtos que não existem ou foram distorcidas.

Como surgem: por que aparecem esse tipo de erro

As alucinações podem ocorrer por várias razões: lacunas na base de dados internalizada, instruções ambíguas no prompt, contexto insuficiente ou até tentativas da IA de “completar” informações ausentes com padrões comuns de texto. Em campanhas rápidas, é comum tentar acelerar a produção sem reservar tempo suficiente para checagens. Além disso, quando a IA é instruída a sintetizar dados ou citar fontes, ela pode inventar referências que parecem plausíveis, embora não existam.

Sinais comuns de alucinações

Reconhecer os sinais é o passo mais prático para agir. Sinais frequentes incluem números que não batem com fontes conhecidas, datas conflitantes, nomes de empresas ou pessoas que não aparecem em fontes públicas, citações inexistentes ou afirmações que contradizem informações já verificadas. Em conteúdos institucionais, fique atento a afirmações sobre políticas, certificações ou prazos que não correspondam aos registros oficiais. Um truque útil é procurar o próprio texto gerado pela IA em busca de trechos repetidos em outros contextos, o que pode indicar algo gerado de forma genérica ou copiado de padrões não confiáveis.

Alucinações são afirmações que parecem verdadeiras, mas não têm base em dados confiáveis.

Não confie cegamente: qualquer dado entendido como fato merece validação com fontes independentes e confiáveis.

Exemplos práticos na prática de marketing

Imagine que uma peça descreva que a empresa X atingiu 200 mil visitantes únicos em um mês específico, com uma citação direta do CEO sobre uma estratégia Y. Se essa informação não estiver publicada em canais oficiais da empresa ou em fontes de imprensa confiáveis, há uma boa chance de ser uma alucinação. Outro exemplo comum é citar dados de mercado com números desatualizados ou aplicá-los a um segmento diferente do que o apresentado no relatório original. Em textos institucionais, afirmações sobre políticas de privacidade ou conformidade sem referência a documentos oficiais também costumam soar duvidosas.

Como detectar alucinações de forma prática

Checklist rápido antes de publicar

Antes de qualquer peça ir ao ar, passe por um checklist curto que funciona para equipes com agendas apertadas. Se conseguir cumprir todos os itens, as chances de alucinações caírem são muito maiores. Comece validando fatos-chave com pelo menos duas fontes independentes, verifique números, datas e nomes, confirme citações com o contexto correto e confirme se o tom está alinhado com a mensagem da marca. Caso haja qualquer informação sensível ou regulatória, reserve um tempo extra para validação humana.

Checklist rápido: fatos-chave checados, fontes verificáveis, números consistentes, datas corretas e citações contextualizadas.

Verificação de fontes e citações

Não basta ter uma fonte; é preciso checar sua autoridade e atualidade. Prefira fontes primárias, como sites oficiais, relatórios regulatórios, estudos de universidades ou órgãos públicos. Se a IA sugerir citações, procure o trecho exato no contexto original para evitar distorções. Em áreas reguladas, como conformidade ou dados do consumidor, a validação com documentos oficiais é ainda mais crítica. E lembre-se: se não houver fonte pública disponível, trate a afirmação como não verificada.

Validação de números, datas e nomes

Quando o conteúdo envolve métricas, datas de lançamento, ou nomes de pessoas e empresas, valide cada item com pelo menos uma segunda referência confiável. Evite usar números aproximados sem deixar claro que são estimativas. Em marketing, é comum usar dados setoriais; nesses casos, indique a fonte e o ano, para evitar confusão com números mais recentes. Em caso de dúvida, considere transformar o trecho em uma comunicação qualitativa (por exemplo, “aumento significativo”) até confirmar o dado exato.

Observação de segurança: para conteúdos que envolvem dados sensíveis ou decisões regulatórias, consulte um profissional da área para evitar riscos legais ou de conformidade.

Processo de revisão para equipes

Papéis e responsabilidades

Defina quem é responsável pela validação de cada tipo de informação: redatores revisores para a consistência de estilo, um responsável pela checagem de fatos com base em fontes externas, e um líder de conteúdo para a conformidade com as políticas da empresa. Em equipes pequenas, esse papel pode se acumular, mas a clareza evita que a validação seja negligenciada.

Roteiro de revisão em 5 etapas

1) Leitura inicial para coesão — 2) Checagem de fatos com fontes confiáveis — 3) Verificação de números, datas e nomes — 4) Revisão de citações e referências — 5) Aprovação final antes da publicação. Esse roteiro simples cria uma spine para qualquer peça, reduzindo a chance de que alucinações passem despercebidas.

Ferramentas para facilitar a validação

Aproveite ferramentas de verificação de fatos, gerenciadores de referências e checklists digitais. Em contextos de equipe enxuta, utilize listas de verificação compartilhadas, marcadores de verificação e notas de briefing com as fontes citadas. O objetivo é criar um ciclo de revisão que não dependa de memória individual, mas de um processo repetível e auditável.

Salvando conteúdo antes de publicar: framework prático

Framework de validação em 6 passos

- Defina o objetivo da peça e o que seria considerado um “fato” confiável para esse objetivo.

- Liste todas as afirmações potencialmente sensíveis (datas, números, nomes, políticas) que precisam ser checadas.

- Buscar, selecionar e comparar pelo menos duas fontes independentes por cada item crítico.

- Atualize o texto com as referências corretas, substituindo afirmações não verificáveis por descrições seguras (ex.: “segundo dados disponíveis” ou “conforme publicação oficial”).

- Faça uma leitura em voz alta para testar clareza e evitar ambiguidades.

- Peça a revisão de alguém fora da equipe para confirmar a compreensão e a confiabilidade do conteúdo.

Este framework não promete perfeição, mas aumenta substancialmente a qualidade e a confiabilidade de cada publicação.

Quando dúvidas surgirem, trate a afirmação como potencial alucinação até que haja verificação objetiva.

Perguntas frequentes sobre alucinações em conteúdo gerado por IA

Por que as alucinações surgem com IA?

Alucinações são resultado de limitações intrínsecas dos modelos de linguagem: eles tendem a gerar texto que parece coerente, mesmo quando não há dados subjacentes para suportar afirmações. Prompts ambíguos, contexto insuficiente e lacunas na base de treinamento podem levar o modelo a “imprimir” respostas que parecem factuais, mas não são. Para equipes, isso reforça a necessidade de validação humana, especialmente para dados sensíveis ou regulatórios.

Qual é o impacto de publicar conteúdo com alucinações?

Errar publicamente pode prejudicar a credibilidade da marca, gerar crises de confiança com leitores e clientes, ou trazer consequências legais se informações regulatórias forem incorretas. Em termos de SEO, conteúdos com informações incorretas tendem a ter taxas de rejeição mais altas e menor retenção, o que prejudica o desempenho ao longo do tempo. A prática de validação reduz esse risco e sustenta a qualidade do ativo de conteúdo.

Quais ferramentas ajudam a detectar alucinações?

Existem ferramentas que ajudam a checar fatos, comparar números com fontes públicas e monitorar citações. Embora não existam soluções perfeitas, combinar verificação humana com utilitários de checagem de fatos e gerenciadores de referências já oferece uma abordagem prática para equipes com pouco tempo. O uso responsável de ferramentas de IA, aliado à revisão humana, tende a reduzir significativamente as alucinações.

Como manter o processo de validação eficiente com pouco tempo?

Adote um fluxo de trabalho com checklists curtos, rotinas de revisão claras e responsabilidades definidas. Use templates de briefing com perguntas-guia para cada tipo de afirmação (números, datas, citações). Integre a checagem de fatos à etapa final da edição, de modo que o conteúdo só avance para publicação quando o checklist estiver completo. A prática constante gera ganhos de velocidade sem perder qualidade.

Quando devo pedir revisão a um humano?

Sempre que houver dados críticos, afirmações regulatórias, nomes de empresas ou pessoas, ou qualquer informação sem fontes públicas fáceis de verificar, envolva um revisor humano. Em situações de alto risco, como conteúdos que influenciam decisões de compra ou conformidade legal, a revisão por alguém com conhecimento específico é essencial. A IA pode acelerar, mas a validação humana mantém a confiabilidade.

Fechamento

Detectar e corrigir alucinações antes de publicar é um hábito essencial para conteúdo de qualidade, especialmente quando o objetivo é manter a confiança do público e evitar riscos desnecessários. Com um entendimento claro do que são alucinações, um conjunto de sinais fáceis de reconhecer e um framework de validação simples, você pode transformar esse desafio em uma vantagem competitiva para a sua PME. Adote as práticas apresentadas, personalize o fluxo para o seu time e siga revisando continuamente para aperfeiçoar o processo.

Perguntas frequentes

Como posso começar a implementar esse framework hoje?

Comece criando um checklist simples com 6 itens-chave (fatos, fontes, números, datas, nomes, citações). Designe um responsável pela validação e reserve 15 a 20 minutos finais de cada ciclo de revisão para checagem rápida. Com o tempo, esse ritual se torna automático e reduz significativamente as alucinações.

Quais tipos de conteúdo são mais suscetíveis a alucinações?

Conteúdos que envolvem dados específicos (números, datas, estatísticas), citações diretas, nomes de empresas/pessoas e afirmações regulatórias são mais vulneráveis. Em textos institucionais ou materiais técnicos, a checagem de fontes é ainda mais crítica para evitar erros graves.

É possível confiar 100% na IA após validação?

Mesmo com validação, a IA não deve ser tratada como fonte única de verdade. A prática recomendada é combinar validação humana com checagem de fatos em fontes confiáveis. Dessa forma, o conteúdo fica mais sólido, mas é natural manter um ciclo de melhoria contínua conforme surgem novas informações.

Existem gatilhos de tempo que ajudam a evitar erros em prazos curtos?

Sim. Estruture o ciclo de vida do conteúdo com janelas de revisão definidas e bloqueios de publicação até a confirmação de fatos críticos. Em cenários de “pressa de publicação”, priorize checagem de dados essenciais (datas, números, nomes) e adie afirmações menos relevantes até ter fontes estáveis.

Posso usar a IA apenas para rascunho e deixar a validação para depois?

É possível, desde que a validação seja parte do fluxo de qualidade. O ideal é que o rascunho gerado pela IA já traga marcas de verificação (fontes citadas ou referências) para facilitar a checagem durante a revisão. Evite depender do rascunho para fatos críticos sem validação prévia.

Observação final: se o conteúdo envolver informações regulatórias ou dados sensíveis, procure um profissional qualificado para orientar a conformidade.